脉冲神经网络(SNN)论文阅读(四)-----IJCAI-2022 多级发射方法的脉冲神经网络

原文链接:CSDN-脉冲神经网络(SNN)论文阅读(四)-----IJCAI-2022 多级发射方法的脉冲神经网络

Multi-Level Firing with Spiking DS-ResNet: Enabling Better and Deeper Directly-Trained Spiking Neural Networks

- 目录

- 说明

- 相关信息

- 主要贡献

- MLF方法

- Dormant-Suppressed Residual Network

- 实验部分

目录

说明

准备将自己读的一些和SNN(脉冲神经网络)相关的一些论文记录下来,方便自己以后回看也希望能够帮到有需要的人。

删除了原始论文中一些自认为不重要的内容而用自己的话对其创新进行简洁描述,如果有什么出错或不恰当的地方希望各位批评指出。

相关信息

论文地址: Multi-Level Firing with Spiking DS-ResNet: Enabling Better and Deeper Directly-Trained Spiking Neural Networks

论文由浙江大学(唐华锦组)研究人员发表于ICJAI 2022,代码发布于here

主要贡献

- 论文提出了multi-level firing (MLF)方法可直接结合STBP训练SNN,MLF能够使得网络中梯度更有效地传播同时增强神经元的表达能力;

- 论文提出了spiking dormant suppressed residual network (spiking DS-ResNet),Spiking DS-ResNet能够在离散的脉冲之间高效地执行恒等映射并。

MLF方法

MLF方法基于LIF神经元,其主要思路为使用MLF unit(可以理解为新的脉冲神经元)替换掉SNN中的LIF神经元。

MLF unit:

- MLF可简单译为多级发射单元,顾名思义,其由多个LIF神经元组成,其中每个LIF神经元具有不同级别的发射阈值,如上图所示。在每个时间步长,MLF unit中的所有LIF神经元都会接收到突触前神经元传递来的信息,每个LIF神经元分别计算自己的膜电势以及输出脉冲。一个MLF unit在一个时间步长内的输出等于其中所有LIF神经元的输出之和。

- 反向传播时使用STBP论文中提出的矩形函数作为代理梯度,公式如下:

- 对于使用了K各级别的MLF unit来说,通过设置每个级别的LIF神经元的发射阈值之间相差a,即可令其近似的梯度分布区域刚好相邻。因此,MLF能够保证高效的梯度传播。其梯度覆盖区域如下图所示(a:当K=1时,MLF unit就是普通的LIF神经元):

Dormant-Suppressed Residual Network

Spiking DS-ResNet:

- 使用tdBN替换掉普通的BN层。

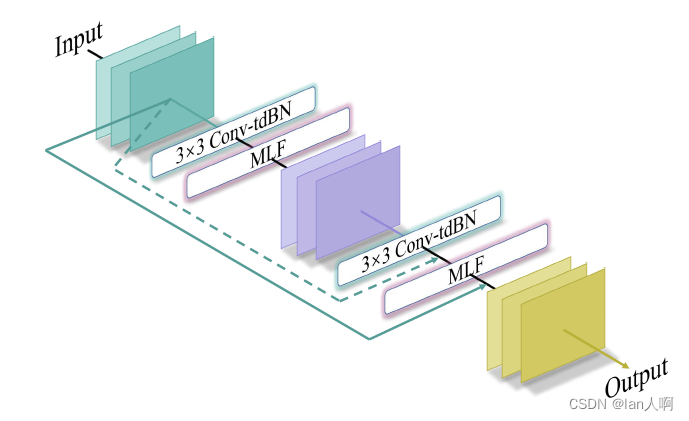

- 改变残差块中激活函数的位置。普通残差块中经过卷积后的数据和shortcut相加后再经过一个激活函数,Spiking DS-ResNet将该激活函数的位置提前,使卷积后的数据先经过激活函数后再和shortcut相加。如上图所示,虚线表示普通残差结构,实现表示Spiking DS-ResNet的残差结构。在SNN中激活函数均为脉冲神经元,因此可以看到,修改后的残差结构中经过卷积后的数据会先经过MLF unit再和shortcut相加。

实验部分

- 作者使用20层的Spiking DS-ResNet在CIFAR-10、CIFAR1-DVS和DVS-Gesture上均进行了实验,实验结果如下:

本文由CSDN-lan人啊原创,转载请注明!