HistoSeg:具有多损失函数的快速注意,用于数字组织学图像中的多结构分割

摘要

大多数分割网络都是基于编解码的网络结构,也利用了复杂的注意力模块或者Trasnsformer模块。但是这些网络在捕获相关的局部和全局特征时还不够准确。无法在多个尺度上进行准确的边界检测。因此,我们提出了一个编码器-解码器网络,快速注意模块和多损失函数(二元交叉熵损失(BCE)损失,焦点损失骰子损失的组合)。

总的来说,本文的贡献如下:1)提出了一种快速注意单元,通过避免不相关的特征来更好的表示全局和局部的特征2)引入了一个多重损失函数,它由Focal Loss,交叉熵损失函数以及Dice Loss组合而成,专注于学习困难样本以及清晰的边界检测 3)提出了一种能捕获密集多尺度特征的编解码器

方法

本文提出的方法具有快速注意单元和多损失函数的编解码器网络。

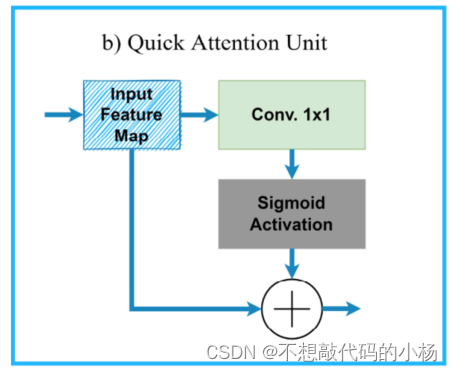

快速注意单元

快速注意单元是一个计算成本相对较低的注意单元,表示为:

这里x是一个输入特征映射,f()是一个步幅为1的1x1卷积,与输入特征映射的滤波器数量相同,σ是一个sigmoid函数。Quick Attention将特征图作为输入WxHxC (Width x Height x Channels),并创建输入特征图的两个实例,然后对第一个实例执行1x1xC卷积,并计算sigmoid激活,然后将其与第二个实例相加,生成与输入尺寸相同的最终注意图作为输出。其结构图如下所示

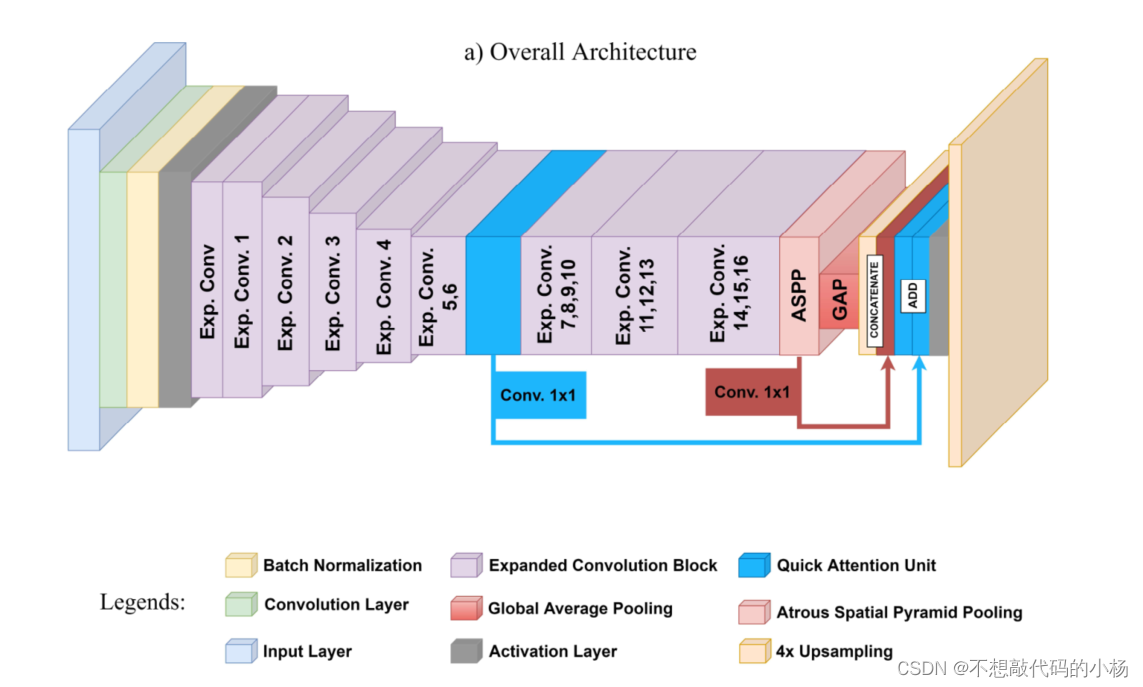

编码器-解码器结构

在对256x256x3维的输入层进行一些改进后,使用3x3卷积、批量归一化和relu激活,激活映射将通过一系列扩展的卷积块来捕获密集特征,而不是在简单卷积和最大池化操作的情况下捕获稀疏特征。每个展开卷积块由1x1卷积、批量归一化、relu激活、深度卷积组成,每个展开卷积之间存在残差连接,如图1 c部分所示。通过指定扩张率参数,深度卷积捕获不同感受野的特征。在扩展卷积6之后,我们引入了快速注意,允许网络捕获更多相关的特征,从现在开始,特征图的空间维度在全球平均池化之前保持不变,在扩展卷积之后,Atrous空间金字塔池化(ASPP)在多个尺度上捕获特征,它执行1x1卷积,以6、12、18的速率进行3x3次扩张卷积,并进行图像池化,然后将所有特征图拼接起来,进行1x1次卷积。整体架构图如下

多重损失函数

我们提出的损失函数是BCE损失,焦点损失和骰子损失的组合。它们中的每一个都单独有助于提高性能。

1)BCE Loss计算概率,并将每个实际类输出与预测概率进行比较,可以是0或1,它基于伯努利分布损失,它主要用于只有两个类可用的情况下,在我们的情况下,恰好有两个类可用,一个是背景,另一个是前景。在一种提出的方法中,它被用于像素级分类。损失表示为

![]()

2)Focal Loss是BCE的一种变体,它使模型能够通过减少简单例子的权值来专注于学习困难的例子。当数据高度不平衡时,Focal Loss表示为

![]()

这里γ总是大于零,但当γ等于1时,它就像一个交叉熵函数,α的范围在0到1之间,它被视为一个超参数

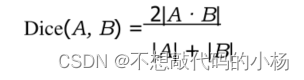

3)Dice Loss的灵感来自于Dice Coefficient Score,这是一种用于评估图像分割任务结果的评估指标。表示为

![]()

而本文使用的损失函数是上述三个损失函数总和,BCE用于像素级分类,Focal Loss用于学习困难的例子,我们使用0.25作为alpha值,2.0作为gamma值。骰子损失用于学习更好的边界表示,我们提出的损失函数表示为

![]()

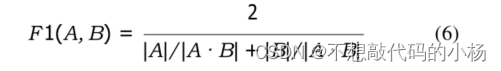

评价指标

1)F1分数用于衡量物体的检测精度。当对象被分割,如果它与它的真实标签相交至少50%,那么它被认为是真阳性,否则它是假阳性。来自真实物体的数量与真阳性物体的数量之间的差异被认为是假阴性。假设F1分数表示为

2)Dice分数衡量的是预测输出和实际情况之间的重叠,所以基本上,它是衡量物体相似性的一种方法。Dice Score定义为

3)IOU交并比