win10搭建spark3.1环境(超详细)

目录

- 0.写在前面

- 1.java环境

- 2.安装scala

- 3.安装spark

- 4.安装hadoop

- 5.安装winutils

- 6.测试程序

0.写在前面

目前Spark官方提供的最新版本3.2.0,是2021年10月份发布,但是该版本搭建Windows下环境,在使用spark-shell时,会报错,尚无解决方案(不知道现在解决没有)。所以我安装的是3.1版本

所使用的到的版本

spark 3.1.3

hadoop 3.2.1

scala 2.12 (注意,spark3.1.2不支持Scala2.13)

java 1.8

使用到的链接

scala官方下载

spark官方下载

hadoop官方下载

winutils下载

另所有使用的东西我都打包到

链接:https://pan.baidu.com/s/1fFEZmqUWZks-Hh5LkKRVww

提取码:1152

1.java环境

这里建议安装java8 不要装太高或者太低的版本

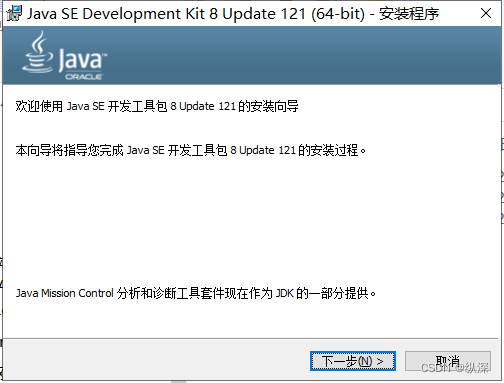

去官网上下载好 双击

点击下一步

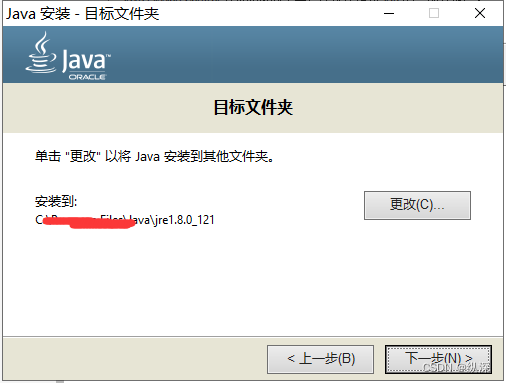

选择你指定的目录 选取下一步 进行安装

这里我安装到了 D:\Java

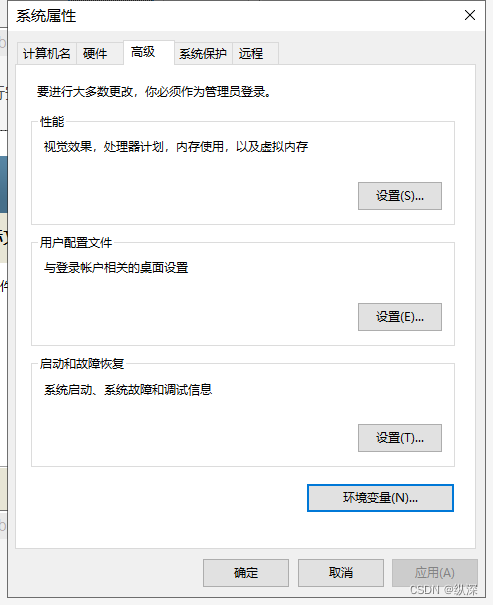

记得配置环境!!!

win10 搜索环境变量 点击环境变量

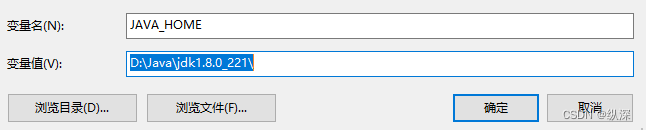

新建变量 JAVA_HOME 注意大写

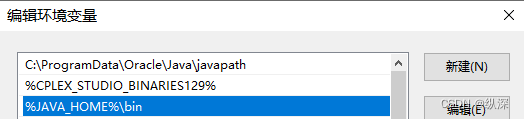

点击编辑 path 新建java环境

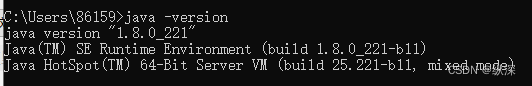

完成以后 进行检验

打开cmd 输入 java -version

这样即可

2.安装scala

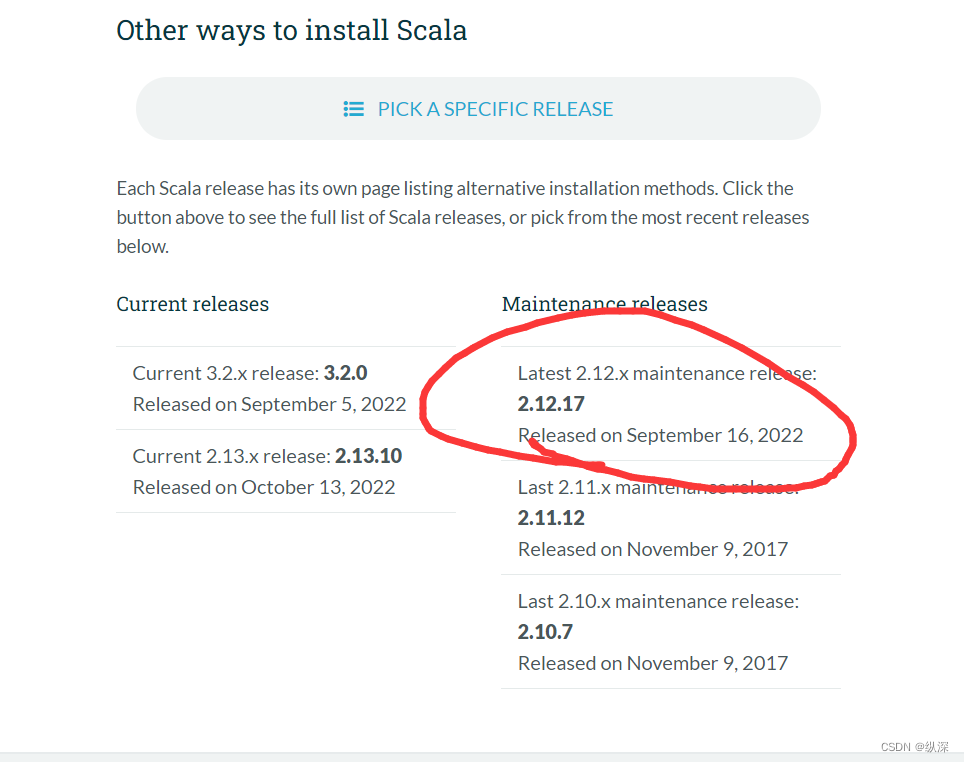

要注意的问题scala的版本要和spark版本对应 这里我安装的scala 2.12

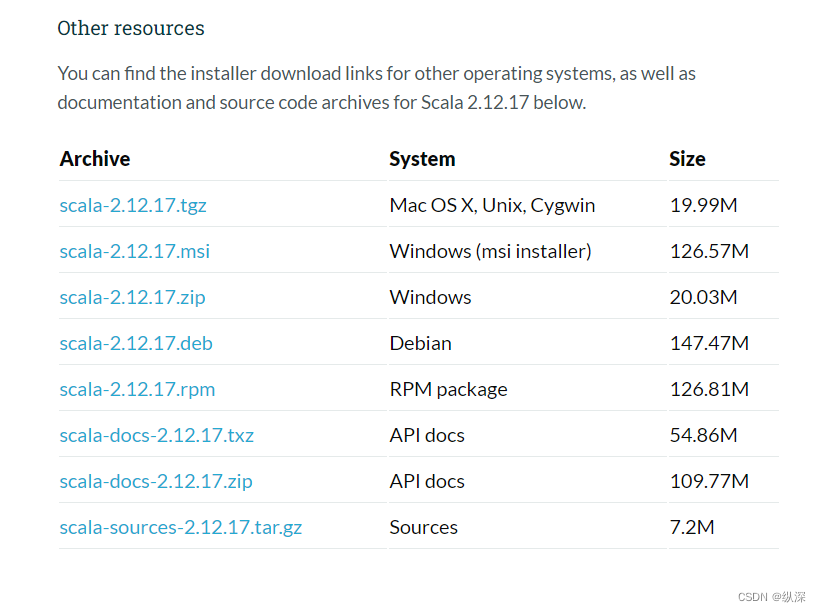

点击链接 滑到下面 点击

往下滑 选择.msi的文件下载安装,会自动在系统中添加环境变量。

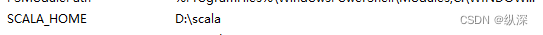

查看是否已经安装变量 (查看是否有SCALA_HOME 和path里面是否已经添加变量)

没有的话 请补充

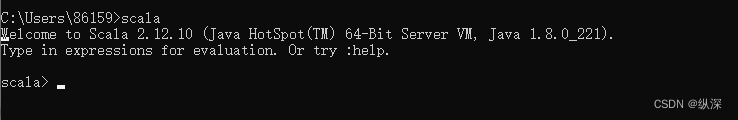

完成以后 进行检验

打开cmd 输入 scala

3.安装spark

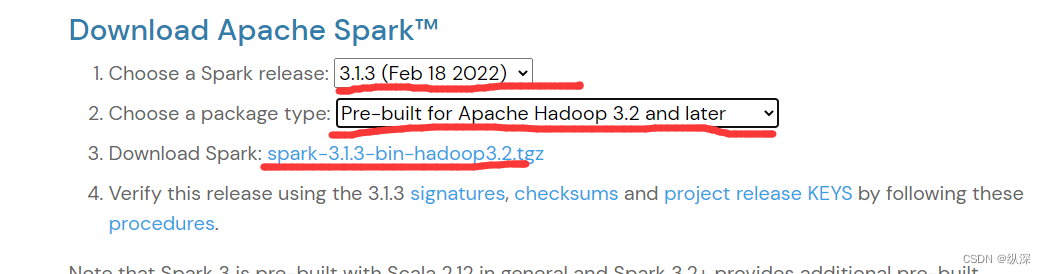

还记得前面的scala与spark对应

这里安装3.1版本

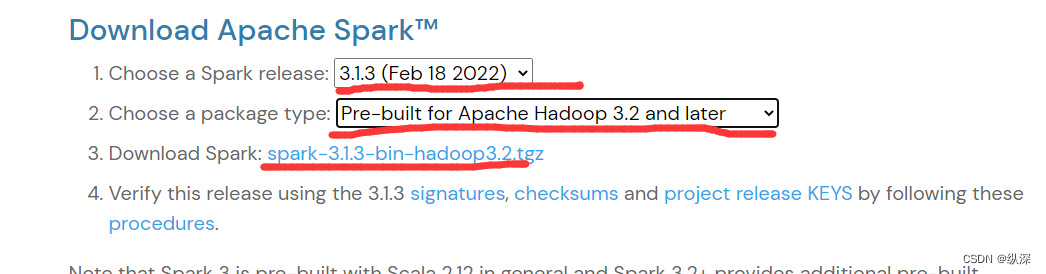

打开链接

注意标红线的地方 进行下载

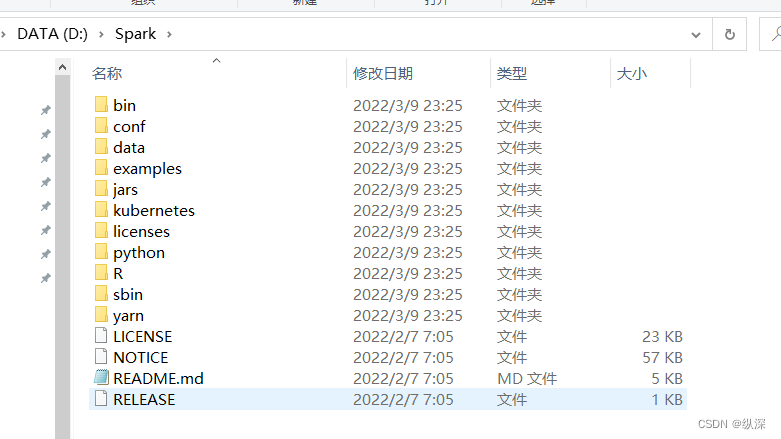

解压

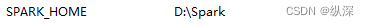

同样的 我们要配置环境 如下图

path 当中环境

其实 改成%SPARK_HOME%\bin 一样的 前面也是

4.安装hadoop

根据之前的

我们 安装 hadoop3.2.1 下载链接

据说tar.gz是编译好的,不需要我们再做编译,包括前面选择也是gz。

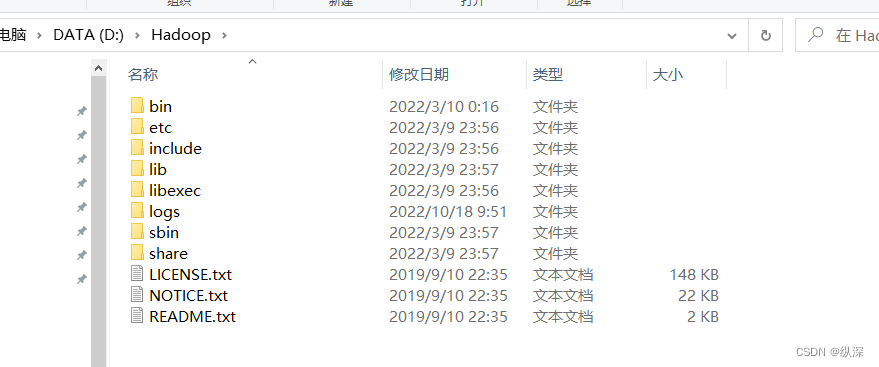

下载,解压到指定目录下

下载,解压到指定目录下

同样的 我们要配置环境 如下图

同样的 我们要配置环境 如下图

在path环境中新建

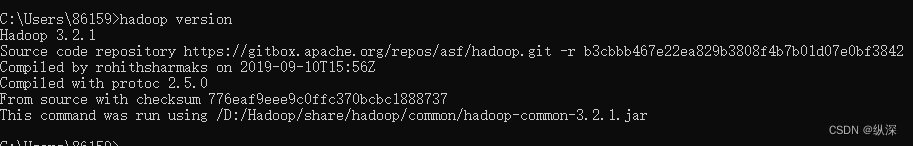

打开cmd

输入 hadoop version

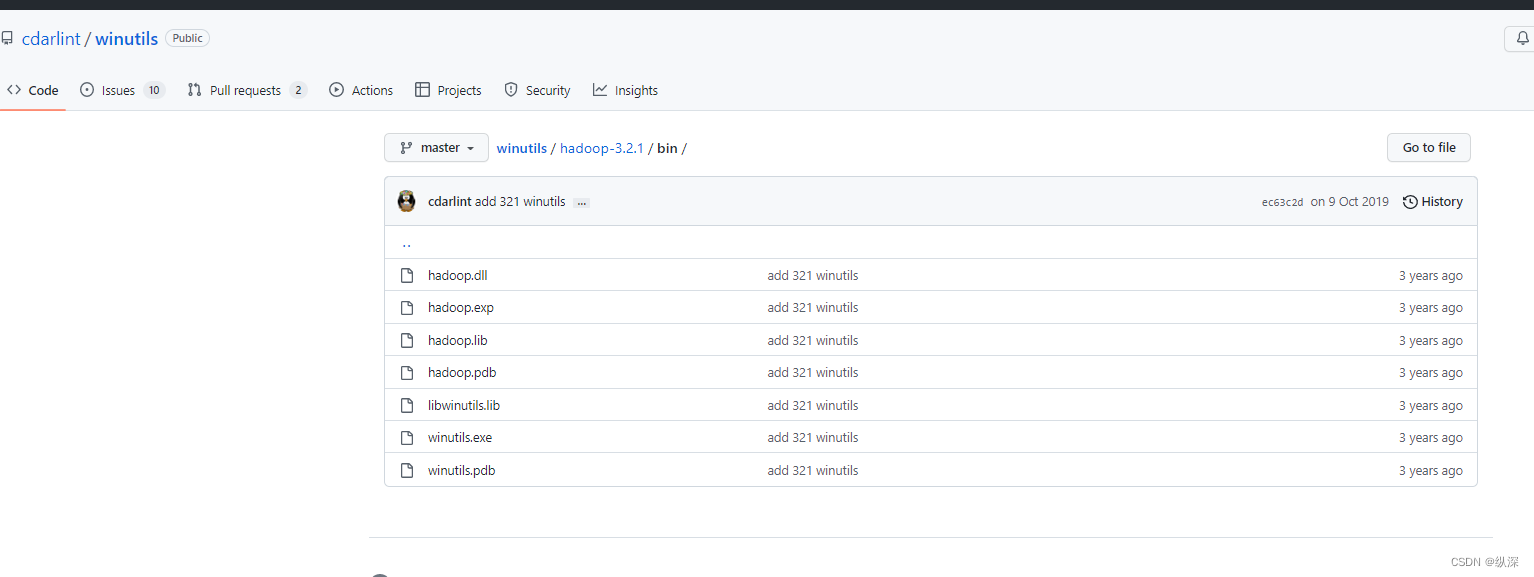

5.安装winutils

链接如下(上文也有)

https://github.com/cdarlint/winutils

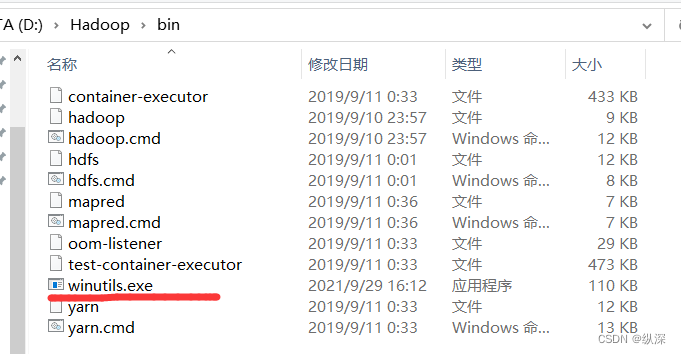

我们进行下载对应版本

把这个文件放到hadoop的bin下

完成

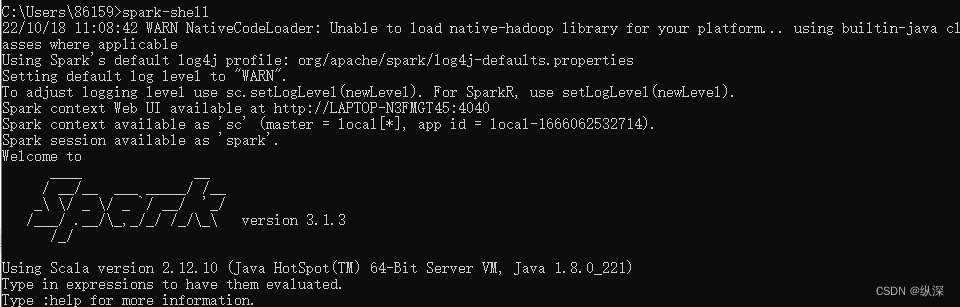

6.测试程序

打开cmd

输入 spark-shell

完成